Statistique - Définition

La liste des auteurs de cet article est disponible ici.

Statistique exhaustive et information

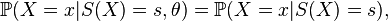

Une propriété intéressante qu'une statistique peut avoir est son caractère exhaustif. Une statistique S est dite exhaustive si la probabilité conditionnelle d'observer X sachant S(X) est indépendante de θ. Cela peut se traduire par la formule suivante:

Cette définition n'étant pas forcément très simple à manier en pratique on préfère souvent utiliser la caractérisation de factorisation des statistiques exhaustives. Ces statistiques exhaustives sont particulièrement importantes car fournissent toute l'information qu'il est possible de récupérer sur le paramètre à partir d'une série d'observations. Une statistique exhaustive apporte donc autant d'information que l'ensemble du vecteur des observations x et l'on ne peut pas récupérer plus d'information que celle contenue dans une statistique exhaustive. Cela se formalise grâce à l'information de Fisher. Si IS est l'information de Fisher apportée par une statistique S et I l'information du modèle:

Avec un cas d'égalité uniquement dans le cas d'une statistique exhaustive. Pour le cas d'un modèle à un seul paramètre cette inégalité est une inégalité classique. Pour le cas des modèles multiparamétrés cette inégalité est une inégalité au sens de la relation d'ordre partielle introduite par:

Statistique robuste

(en) Robust statistics