Entropie - Définition

En thermodynamique, l'entropie est une fonction d'état introduite au milieu du XIXe siècle par Rudolf Clausius dans le cadre du second principe, d'après les travaux de Carnot[1]. Clausius a montré que le rapport Q/T (où Q est la quantité de chaleur échangée par un système à la température T) correspond, en thermodynamique classique, à la variation d'une fonction d’état qu'il a appelée entropie, S et dont l'unité est le joule par kelvin (J/K).

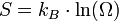

La thermodynamique statistique a ensuite fourni un nouvel éclairage à cette grandeur physique abstraite : elle mesure le degré de désordre d'un système au niveau microscopique. Plus l'entropie du système est élevée, moins ses éléments sont ordonnés, liés entre eux, capables de produire des effets mécaniques, et plus grande est la part de l'énergie inutilisée ou utilisée de façon incohérente. Boltzmann a formulé une expression mathématique de l'entropie statistique en fonction du nombre d’états microscopiques Ω définissant l’état d'équilibre d'un système donné au niveau macroscopique : formule de Boltzmann S = k Ln Ω.

Cette nouvelle définition de l'entropie n'est pas contradictoire avec celle de Clausius. Les deux expressions de l'entropie résultent simplement de deux points de vue différents, selon que l'on considère le système thermodynamique au niveau macroscopique ou au niveau microscopique.

Dans une période récente le concept entropie a été généralisé et a pénétré dans de nombreux domaines, tels que par exemple :

- l'entropie de Shannon dans le cadre de la théorie de l'information en informatique;

- l' entropie topologique, ainsi que l'entropie métrique de Kolmogorov-Sinaï, dans le cadre de la théorie des système dynamiques en mathématiques.

L’entropie selon la thermodynamique classique

La non-conservation de l’entropie

La difficulté à donner une définition intuitive de l’entropie d’un système vient du fait qu’elle ne se conserve pas. Elle peut augmenter spontanément lors d’une transformation irréversible. En effet, selon le second principe de la thermodynamique, l’entropie d’un système isolé ne peut pas diminuer, elle augmente ou elle reste constante si la transformation est réversible.

Les transformations réversibles

Une transformation affectant un système thermodynamique est dite réversible si elle est quasistatique et s’effectue sans frottements entraînant un phénomène dissipatif de chaleur. Dans ces conditions, la transformation peut être considérée comme étant constituée d’une succession d’états d’équilibre. Si on inverse le sens de la contrainte du milieu extérieur, responsable de la transformation, on repasse alors par les mêmes états d’équilibre puisqu’il n’y a pas eu de phénomènes dissipatifs. On peut alors modéliser la transformation et décrire parfaitement, à chaque instant, l’état d’équilibre du système.

La transformation réversible est donc un modèle idéal (à rapprocher du modèle idéal du gaz parfait), dont on peut se rapprocher dans les transformations réelles, en s’assurant que la transformation soit très lente, le déséquilibre des variables d'état très faible et en minimisant les frottements.

Remarque : Une transformation réversible qui serait filmée pourrait être projetée à l'envers (c'est-à-dire de la fin au début) sans que la séquence paraisse anormale. C'est par exemple le cas, en première approximation, pour une balle en caoutchouc qui rebondit une fois sur un sol dur, il serait difficile de distinguer si le film est projeté à l'endroit ou à l'envers. En toute rigueur cela est faux car les frottements lors du choc et les frottements de l'air aussi faibles soient-ils rendent le processus irréversible et après plusieurs rebonds, la balle s'arrêterait. Le film à l'envers serait alors choquant puisque la balle rebondirait de plus en plus haut !!!

À l'inverse, une transformation foncièrement irréversible ne permet pas de faire ce constat, comme dans le cas d'un œuf s'écrasant sur le même sol dur : projeté à l'envers on verrait l'œuf brisé se reconstituer puis monter en l'air. On trouve dans cette interprétation une manifestation de la flèche du temps.

Les transformations irréversibles

Les transformations réelles sont irréversibles à cause de phénomènes dissipatifs. Le système ne peut jamais spontanément, revenir en arrière. L’énergie perdue par le système sous forme de chaleur contribue à l’augmentation du désordre global. Or le désordre est mesuré par une fonction d’état appelée entropie : S, introduite par le second principe de la thermodynamique.

Alors que le premier principe est un principe de conservation de l’énergie, le second principe est un principe d’évolution. Il stipule que toute transformation réelle s’effectue avec augmentation du désordre global (système + milieu extérieur) ; le désordre étant mesuré par l’entropie. On dit encore qu’il y a création d’entropie.

L’expression moderne du second principe formalise cette création d’entropie :

- ΔS(global) = ΔS(créée) = ΔS(système) + ΔS(extérieur) > 0

Dans le cas de la transformation idéale réversible, il n’y a pas de création d’entropie :

- ΔS(créée) = ΔS(système) + ΔS(extérieur) = 0.

L’entropie comme monnaie d’échange

La thermodynamique classique définit l’entropie comme une grandeur extensive, ce qui signifie que l'on obtient l'entropie d'un système en faisant la somme des entropies de ses parties constituantes (par contraste, la température n’est pas une grandeur extensive parce que la température d’un système n’est pas la somme des températures de ses parties).

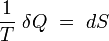

Tant que les transformations sont réversibles, on peut raisonner sur l’entropie comme une grandeur conservée. Comme elle peut passer d’un système à un autre ou vers le milieu extérieur, elle est une sorte de monnaie d’échange. Tout système qui gagne de l’entropie la prend à un autre ou au milieu extérieur. L'unité d’entropie, le Joule par Kelvin correspond à la quantité d’entropie gagnée par un système qui reçoit 1 Joule de chaleur par Kelvin. De façon générale, si un système reçoit δQ Joules de chaleur lors d’une transformation infinitésimale réversible à la température T, alors son entropie augmente de : dS(syst) = δQ(rév)/T

Cela devient pour une transformation réversible effectuée à la température T constante : ΔS(syst) = Q(rév)/T

L’entropie est une fonction d’état. Cela veut dire que sa valeur est déterminée dès que l’état d’équilibre du système est établie. Comme l'entropie d'un corps pur, à la température de zéro Kelvin, est nulle car le système est parfaitement ordonné, on peut construire une échelle absolue d'entropie à l'inverse des autres fonctions d'état se déduisant de l'énergie interne qui elle, n'est pas calculable.

Si la transformation est irréversible, la chaleur mise en jeu devient Q(irrév) car la chaleur dépend du chemin suivi. De plus, on a vu précédemment qu'il y avait création d'entropie et que le bilan entropique est positif :

ΔS(syst) + ΔS(ext) > 0.

Or la chaleur fournie par le système Q(irrév) est reçue par le milieu extérieur et donc son signe s'inverse - Q(irrév).

La variation de l'entropie du milieu extérieur est alors égale à : ΔS(ext) = -Q(irrév)/T.

Le bilan entropique devient : ΔS(syst) - Q(irrév)/T > 0

on obtient alors l'inégalité formulée par Clausius pour les transformations irréversibles :

- ΔS(syst) > Q(irrév)/T

Conséquence de l’inégalité de Clausius sur la quantité de travail fourni par un système

Considérons une transformation effectuée à la température T, qui fait passer un système thermodynamique d’un état initial A à un état final B d’équilibre.

La variation d’entropie du système, associée à cette transformation, peut s'écrire : ΔS(syst) = S(B) – S(A)

On peut procéder de façon réversible ou bien de façon irréversible. Si la variation de la fonction d'état entropie sera la même, il n’en est pas de même pour la chaleur Q et le travail W qui dépendent du chemin suivi et seront donc différents : Q(rév) ≠ Q(irrév) et W(rév) ≠ W(irrév).

Appliquons le second principe :

- ΔS(syst) = S(B) – S(A) = Q(rév)/T

- ΔS(syst) = S(B) – S(A) > Q(irrév)/T

d’où Q(rév) > Q(irrév)

Appliquons le premier principe de conservation de l’énergie interne U :

- ΔU(syst) = U(B) – U(A) = W(rév) + Q(rév) = W(irrév) + Q(irrév)

On déduit que W(rév) < W(irrév)

Pour un système (moteur thermique, moteur électrique…) dont la fonction est de fournir du travail au milieu extérieur, le travail fourni est compté négativement d’après la règle des signes : W < 0

Donc ce qui compte c’est la valeur absolue du travail fourni et l’inégalité s’inverse :

|W(rév)| > |W(irrév)|

On en déduit que la quantité de travail utile fourni par un système est plus importante lorsque la transformation est réversible.

Remarques :

- Les frottements étant la principale cause d’irréversibilité, on comprend pourquoi on essaye de les minimiser ; c’est le but de la lubrification des pièces en contact et en mouvement dans un ensemble mécanique.

- Pour la même quantité d’essence on récupère moins de travail mécanique plus une voiture va vite et la distance parcourue est donc plus faible. La vitesse est un facteur d’irréversibilité.

- Une pile électrique fournit plus de travail électrique si son fonctionnement se rapproche de la réversibilité (faible tension et faible courant de fonctionnement). En revanche si on court-circuite les électrodes, on ne récupère pratiquement que de la chaleur !

Définition de l'entropie selon la physique statistique

La matière est formée de particules (molécules, atomes, électrons...) en perpétuel mouvement (agitation thermique) exerçant les unes sur les autres une force attractive (interactions) dont l'intensité décroit lorsque leur distance mutuelle augmente. Dans un gaz cette distance est relativement grande, les interactions sont donc faibles, de sorte que les particules sont libres de se déplacer dans tout le volume qui leur est offert, mais subissent de nombreuses collisions au cours desquelles leur énergie varie. Dans un liquide les distances mutuelles sont plus petites et les molécules sont moins libres: elles peuvent se déplacer dans tout le volume du liquide mais ne peuvent pas en sortir. Dans un solide chaque molécule est liée élastiquement à ses voisines et vibre autour d'une position moyenne fixe. Il en résulte que, dans tous les cas, la position et l'énergie de chaque particule sont aléatoires.

La somme des énergies de toutes les particules d'un système thermodynamique donné s'appelle l'énergie interne U du système. Lorsque le système est isolé (il n'échange ni matière ni énergie avec l'extérieur) son état macroscopique est caractérisé par son volume V et son énergie interne U. Cependant les particules peuvent être disposées dans le volume d'un très grand nombre de façons différentes; de même l'énergie interne peut être répartie sur les particules d'un très grand nombre de façons différentes. Chaque façon de placer les molécules dans le volume et de leur distribuer l'énergie interne s'appelle une configuration microscopique de l'état macroscopique caractérisé par le volume V et l'énergie interne U. Le nombre de particules étant, dans un système macroscopique, immensément grand (de l'ordre de 1023) le nombre Ω(U,V) de ces configurations microscopiques est lui-même immensément grand. On définit alors l'entropie S (fonction de U et V) par

où kB = 1,381.10 − 23J.K − 1 s'appelle la constante de Boltzmann.

Cette relation a été proposée par Ludwig Boltzmann vers les années 1870 alors que la notion d’états microscopiques était encore très spéculative, parce que les atomes et leurs propriétés quantiques étaient mal connus. Il a été en butte à la moquerie des scientifiques de son époque ce qui l'a vraisemblablement conduit au suicide. Aujourd'hui il est considéré comme le père fondateur de la thermodynamique statistique. Sur sa tombe à Vienne est gravée la "fameuse formule".

Un système évolue en permanence d'une configuration microscopique à une autre. Le principe fondamental que l'on admet en thermodynamique est que à l'équilibre toutes les configurations microscopiques apparaissent avec la même probabilité. Cet axiome est l'énoncé le plus profond du second principe de la thermodynamique.

L'entropie jouit de la propriété d'additivité (on dit que c'est une grandeur extensive): l'entropie d'un système à l'équilibre est égale à la somme des entropies de chacune de ses parties. Par exemple si l'on sépare le système en deux parties, d'entropies respectives S1 et S2 et ayant pour chacune des parties Ω1 et Ω2 configurations, l'entropie globale S est égale à S1 + S2. D'où S = S1 + S2 = kLnΩ1 + kLnΩ2 = kLnΩ1Ω2 = kLnΩ

Il s'ensuit que le nombre de configurations du système Ω = Ω1.Ω2.

Exemples de compréhension

- Entropie et désordre

Il est courant de dire que l'entropie est une mesure du désordre. En effet, considérons par exemple un jeu de 52 cartes et posons-les toutes du même côté (ordre parfait); cet état macroscopique ne peut être réalisé que d'une seule façon: Ω = 1. Retournons 1 carte, ce qui est le début du désordre; mais il y a Ω = 52 façons de réaliser l'état macroscopique "une seule carte retournée". Le désordre est maximum quand 26 cartes sont d'un côté et 26 cartes de l'autre côté; le nombre de configurations microscopiques de cet état de désordre maximum est alors Ω = 4,96.1014 ! Dans cet exemple le nombre de configurations microscopiques (donc l'entropie) est bien une mesure du désordre. Mais il faut être prudent dans l'utilisation de cette notion de désordre, qui est souvent subjective, et lui préférer le nombre Ω de configurations qui est objectif (c'est un nombre).

- Equilibre et maximum d'entropie

Reprenons le jeu de 52 cartes et supposons qu'on les jette en l'air de telle sorte que chaque carte retombe d'un côté ou de l'autre avec la même probabilité. Si l'on recommence l'opération un grand nombre de fois les valeurs numériques précédentes montrent que le désordre maximum apparaîtra beaucoup plus souvent que toute autre situation.

Considérons maintenant un gaz dans un récipient de volume V. Il comporte non pas 52 molécules mais de l'ordre de 1023. Parmi toutes les façons possibles de ranger ces molécules, il y en a un certain nombre qui laissent la moitié du volume vide (ce qui correspond à toutes les cartes du même côté) mais un nombre immensément plus grand pour lesquelles elles sont uniformément réparties dans tout le volume. Comme toutes ces configurations microscopiques sont équiprobables, la répartition uniforme est réalisée immensément plus souvent que toute autre situation, au point qu'elle apparaît macroscopiquement comme un équilibre stationnaire; et ceci simplement parce que le nombre de configurations microscopiques, et donc l'entropie, qui lui correspondent ont leur valeur maximale. L'équilibre d'un système thermodynamique se produit quand son entropie a la valeur maximale compatible avec les contraintes auxquelles il est soumis (ici la contrainte est le volume).

- Evolution inéluctable vers le désordre

Considérons toujours le jeu de 52 cartes. On les ordonne en les rangeant par ordre décroissant de valeur, de l’as au 2 dans une couleur; les couleurs étant rangées dans l’ordre suivant : trèfle, carreau, cœur et pique. Avec cette contrainte définissant l'ordre parfait, il n’existe qu’une seule configuration ordonnée : Ω(ordonnée) = 1. L’entropie définie selon Boltzmann serait alors égale à :

S = k Ln Ω(ordonnée) = 0 (le système est parfaitement ordonné)

Combien y a t-il d’arrangements possibles des cartes dans le jeu ; c’est-à-dire de configurations ?

Ω = factorielle de 52 = 52 ! = 8.1067 C’est un nombre énorme !

On constate alors que les configurations désordonnées sont extrêmement majoritaires par rapport à la configuration ordonnée.

Supposons maintenant que l’on fasse évoluer le système ordonné en battant le jeu toutes les secondes. Existe t-il une chance de revenir à l’état initial ordonné ?

Toutes les configurations ont la même probabilité et il y en a 8.1067. Si chaque configuration existait pendant 1 seconde, il faudrait battre le jeu pendant 8.1067 s, soit 2,5.1051 milliards d’années…pour avoir une chance de revenir à l’état ordonné.

Réfléchissons maintenant sur une mole de gaz parfait dans les conditions normales de température et de pression. Le nombre de particules NA = 6,022.1023 est énorme. À l’inverse du jeu précédent où chaque carte est unique et est définie par un seul paramètre, chaque particule de gaz est définie par 3 paramètres de position spatiale et un paramètre d’énergie (agitation thermique). Le nombre de configurations ou complexions est pharamineux. Néanmoins, grâce à la thermodynamique statistique, il a été possible de le calculer dans le cas d'un gaz parfait pris dans les conditions normales ( volume molaire de 22,4 L):

Ω = 10(5.E24) configurations !!!

De plus, il faut remarquer qu’avec l’agitation thermique, le système est en perpétuel changement. Bien évidemment les configurations désordonnées sont les plus nombreuses.

Ce sont ces configurations désordonnées qui occupent la majorité du temps et définissent l’état d’équilibre du système à l’échelle macroscopique.

On pourrait faire la comparaison avec un tableau post-impressioniste de la période pointilliste (voir Seurat, Signac). Quand on s'approche du tableau, on devine tous les différents points de couleur mais quand on s'éloigne suffisamment on a une vision d'ensemble qui est largement influencée par les points de couleur les plus nombreux.

L’application de la formule de Boltzmann permet de ramener la valeur de l'entropie à notre échelle:

S = k Ln Ω = k Ln [10(5.E24)]

Constante de Boltzmann k = R/NA = 1,381.10-23 J.K-1

S = 159 J.K-1; C’est l’entropie d’une mole de gaz parfait dans les conditions normales.

A zéro Kelvin, l’agitation thermique s’arrête, le gaz se trouve alors dans l'état fondamental de plus basse énergie. Deux cas sont possibles :

- Si l'état fondamental est non-dégénéré, il n’y a plus qu’une seule configuration et l’entropie est nulle S = 0.

- Si l'état fondamental est dégénéré, il existe en général un nombre fini d'états dégénérés. Si g est ce nombre, l'entropie prend sa valeur minimale pour S0 = k ln g.

Remarques d’ordre général

- L'intuition commune comprend déjà difficilement le concept énergie, cette grandeur qui, pour un système isolé, a la propriété de se conserver jusqu'à la nuit des temps.

Autrement surprenant est le concept entropie. Pour le même système isolé, l'entropie, dans le meilleur des cas, restera constante, mais en dehors de ce cas très théorique des transformations réversibles, elle ne fera que croître indéfiniment.

Une diminution d'entropie pour un système est néanmoins possible si l’augmentation de l’entropie du milieu extérieur fait plus que compenser la diminution d’entropie du système. Le bilan reste conforme à la deuxième loi de la thermodynamique : une augmentation globale de l'entropie assimilée à une création d'entropie. Démontrons le dans le cas d'un système composé d'un vase contenant de l'eau liquide que l'on place à l'air libre à -10 °C soit 263 K. L'eau gèle à 0 °C (273 K) et tant qu'il y a coexistence de glace et d'eau liquide cette température de changement d'état reste constante et égale à 273 K. La chaleur de solidification de l'eau: L(solid) est négative (inverse de la chaleur de fusion qui elle est positive) ainsi que l'entropie de solidification ΔS(syst) = L(solid) / 273 < 0. En revanche, la chaleur est reçue par le milieu extérieur et change de signe (- L(solid)); milieu extérieur dont la température n'est pas affectée par l'échange avec le système beaucoup plus petit (notion de source de chaleur). Elle reste constante et égale à 263K. La variation d'entropie du milieu extérieur est alors égale à :

ΔS(ext) = - L(solid) / 263 > 0.

Calculons alors le bilan entropique :

ΔS(syst) + ΔS(ext) = ( L(solid) / 273 ) + ( -L(solid) / 263 ) = L(solid) ( 1/273 - 1/263 ).

Comme L(solid) < 0, il s'ensuit que le bilan est positif et l'entropie créée sera d'autant plus grande que l'écart des températures sera grand ainsi que l'irréversibilité qui va de pair. Si la température du milieu extérieur était très proche de 273 K à -ε près, on se rapprocherait d'une transformation réversible et le bilan entropique serait proche de zéro. En toute rigueur le changement de température entre le système et le milieu extérieur n'est pas brutal. Au voisinage de la paroi séparant le système du milieu extérieur la température varie de façon continue entre 273 K et 263 K. On dit qu'il y a un gradient de température ; phénomène intimement associé à la notion d'irréversibilité.

- L'expression " degré de désordre du système " introduite par Boltzmann peut se révéler ambigüe. En effet on peut aussi définir l'entropie comme une mesure de l'homogénéité du système considéré. L'entropie d'un système thermique est maximale quand la température est identique en tout point. De même, si on verse un liquide colorant dans un verre d'eau, l'entropie du système coloré sera maximale quand, suite au mélange, la couleur du contenu sera devenue uniforme. L'entropie d'un tableau parfaitement lisse et blanc est maximale et ne contient aucune information visible. Si on y ajoute un point coloré, l'entropie diminue, et une information a été ajoutée. Ceci illustre pourquoi, à la naissance de la théorie de l'information, la quantité d'information contenue dans un système était appelée " néguentropie ". Tout système isolé, siège d'une agitation aléatoire, tend spontanément à s'homogénéiser de manière irréversible. C'est pourquoi la notion d'entropie, telle qu’elle est définie par la physique statistique, a été utilisée en théorie de l'information par Claude Shannon au début des années 1950 pour mesurer la perte d'information. voir aussi l'article détaillé : Entropie de Shannon.

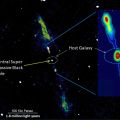

- Un des grands enjeux de la physique moderne est de déterminer si les trous noirs possèdent ou non une entropie. Si c'est le cas, alors ils doivent avoir une température et donc émettre un rayonnement électromagnétique, ce qui viole le principe classique du trou noir (aucun rayonnement ne peut s'échapper d'un trou noir mais il s'évaporerait par sa surface soumise à des interactions énormes).

Etymologie

Le mot entropie a été inventé par Clausius qui justifie son choix dans Sur diverses formes des équations fondamentales de la théorie mécanique de la chaleur (1865):

Je préfère emprunter aux langues anciennes les noms des quantités scientifiques importantes, afin qu'ils puissent rester les mêmes dans toutes les langues vivantes; je proposerai donc d'appeler la quantité S l'entropie du corps, d'après le mot grec η τροπη une transformation. C'est à dessein que j'ai formé ce mot entropie, de manière qu'il se rapproche autant que possible du mot énergie; car ces deux quantités ont une telle analogie dans leur signification physique qu'une analogie de dénomination m'a paru utile. (cité dans Dictionnaire d'histoire et de philosophie des sciences de Dominique Lecourt, chez PUF, 1999).

Pour en savoir plus

Approche thermodynamique de Carathéodory (1908)

Dès la fin du XIXe siècle, la thermodynamique développée initialement pour les machines thermiques fût appliquée avec succès aux phénomènes electriques et magnétiques, aux changements d'états, et aux réactions chimiques. C'est pourquoi l'introduction traditionnelle de l'entropie basée sur l'étude des machines thermiques cycliques fût critiquée au début du XXe siècle pour son manque de généralité, notamment par Born. Stimulé par cette critique, Carathéodory a remplacé en 1908 cette approche par un traitement purement axiomatique basé sur les propriétés d'intégrabilité des formes différentielles de Pfaff.

En prenant comme postulat de sa thermodynamique d'équilibre qu'il existe des états inaccessibles par voie adiabatique dans le voisinage de tout état d'équilibre donné, Carathéodory[2] démontre l'existence (locale[3]) d'une fonction entropie. En termes techniques, Carathéodory démontre que la forme différentielle " tranfert thermique élémentaire " δQ admet un facteur intégrant 1/T, i.e. que :

est une différentielle exacte, propriété des fonctions d'état.

Pour voir le lien avec le postulat initial, on remarque que tous les états accessibles par voie adiabatique (δQ = 0) à partir d'un état initial Ei sont alors nécessairement situés sur la surface isentropique S=S(Ei) =cte. Il existe donc des états inaccessibles par voie adiabatique, à savoir tous ceux qui ne sont pas situés sur cette surface. Le théorème de Carathéodory établit la réciproque non-triviale : si il existe des états inaccessibles par voie adiabatique, alors il existe un facteur intégrant, et donc une fonction d'état entropie (Cf. livre de Rocard).

Cette présentation axiomatique reçue à l'époque un accueil enthousiaste de Born, Landé, Chandrasekhar, et Buchdahl, mais son orientation mathématique a rebuté nombre de physiciens, et elle est restée relativement confidentielle jusqu'à ce qu'elle soit simplifiée à la fin des années 1950[4] par L. A. Turner, F. W. Sears, et Peter T. Landsberg[5].

Approche thermodynamique de Lieb-Yngvason (1997)

En 1997, Lieb et Yngvason ont proposé[6] une nouvelle dérivation de l'existence de l'entropie en thermodynamique d'équilibre qui ne fait appel ni aux machines thermiques, ni à la température, ni même aux concepts plus primitifs de " chaud " et de " froid " (et encore moins à la physique statistique). Leur approche est basée sur la notion d'états d'équilibres " accessibles par voie adiabatique " (i.e. dans l'esprit de Carathéodory), mais où leur notion d'accessibilité adiabatique est définie - dans l'esprit de Planck (1926) - de façon purement mécanique à travers le déplacement d'un poids, sans référence au concept de transfert thermique. Dans cette approche, la température apparait à la fin comme une dérivée partielle de l'entropie, une fois que la différentiabilité de cette fonction a été démontrée.